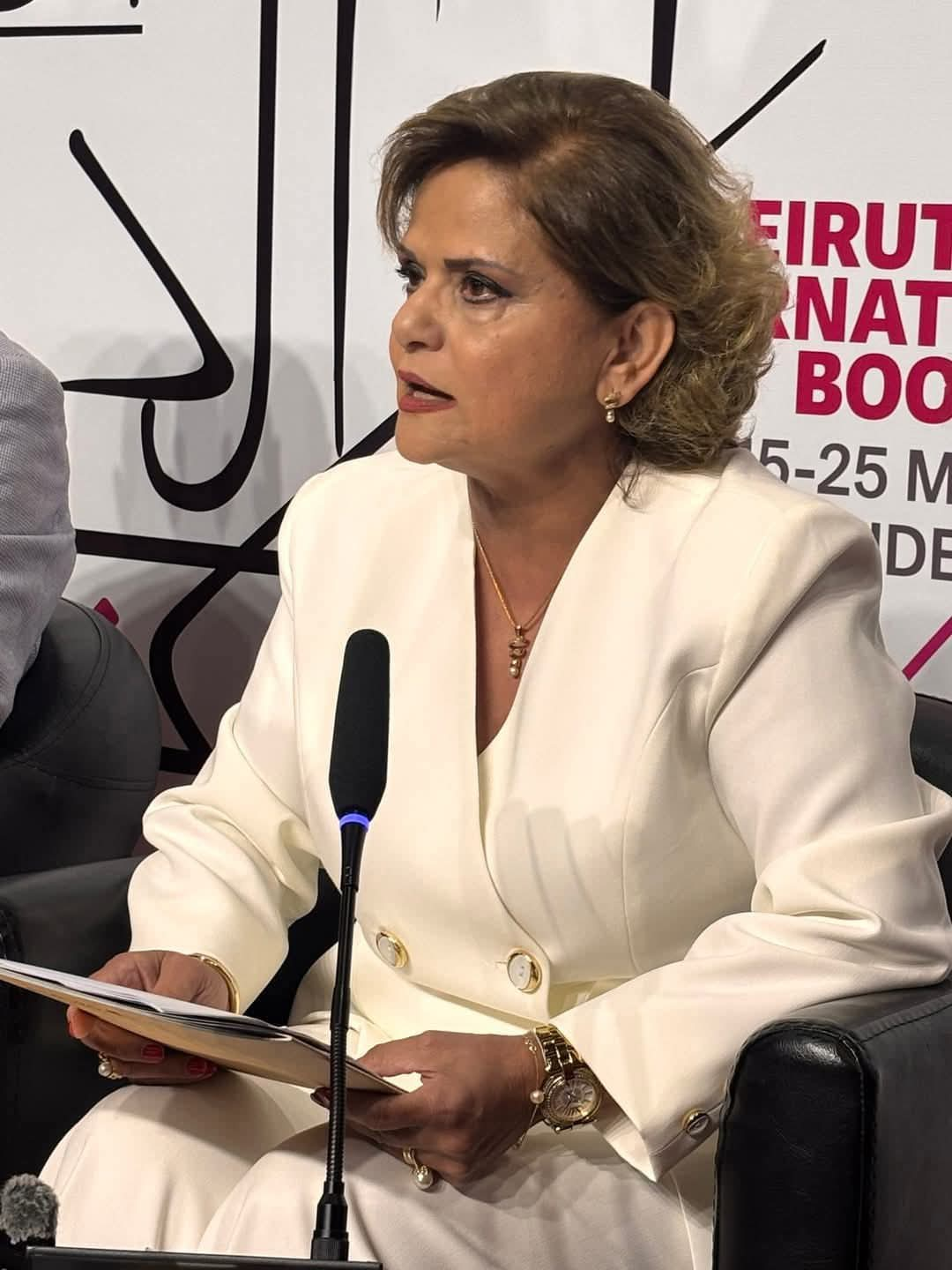

د.سلوم عن كتابها الذكاء الاصطناعي تحديات قانونية واخلاقية

نبيل حرب

في احتفالية ثقافية مميزة وحاشدة تم توقيع كتاب “الذكاء الاصطناعي تحديات قانونية وأخلاقية” للدكتورة أودين سلوم الحايك ، في إطار المهرجان اللبناني للكتاب الذي تنظمه الحركة الثقافية انطلياس…

كلمات كثيرة القيت وكلها اشادت بمحتوى الكتاب الذي اعتبره البعض مرجعا قانونيا حول تحديات الذكاء الاصطناعي…

التقينا الدكتورة اودين سلوم الحايك وهي استاذة محاضرة في كلية الحقوق في الجامعة اللبنانية وسألناها عما تضمنه الكتاب وما الذي دفعها لكتابته؟ومنظورها القانوني للذكاء الاصطناعي والمخاطر التي يمكن ان يشكلها على خصوصية الافراد وبياناتهم الشخصية وكان هذا الحوار…

*ما الذي دفعكِ لكتابة هذا الكتاب في هذا التوقيت بالذات؟

يعتبر الذكاء الاصطناعي من مواضيع اللحظة، في عصر نعيش فيه في زمن حاسم من التقدم التكنولوجي. لا بل هو الموضوع الذي لا مفر منه كونه على اتصال مباشر بالواقع. ومن الواضح أن المسألة لم تعد في التساؤل عما إذا كان من المناسب إدخال هذه التقنيات في نظام حياتنا، لأنها دخلت وتدخل في مفاصل حياتنا كافة بإرادتنا أم بغير إرادتنا، وهذا هو الحال بالفعل ، بشكل لا رجعة فيه. لذا بات علينا تنظيم هذا الذكاء، والبحث في المسائل القانونية التي يثيرها، من هنا كان سبب وجود الكتاب، كون تنظيم الذكاء يتطلب تضافر جهود القانونيين والتقنيين على حد سواء.

*كيف ترين أهمية معالجة التحديات القانونية والأخلاقية للذكاء الاصطناعي في السياق اللبناني والعالمي؟

إلى جانب التقدم الذي يسمح به الذكاء الاصطناعي فهو يهدد الحقوق الأساسية، ما دفع الدول على العمل إلى الحد من الآثار السلبية للذكاء الاصطناعي على الحقوق الأساسية. يبرز الاهتمام بالحفاظ على الحقوق الأساسية في سياق الذكاء الاصطناعي من قبل الهيئات الدولية الرئيسية مثل الأمم المتحدة أو الاتحاد الأوروبي. ولذلك، فإن المشترع الأوروبي أصدر قانون الذكاء الاصطناعي وهو قانون شامل في هذا الإطار ودعا الدول إلى ضمان احترام الحقوق الأساسية، واتخاذ تدابير مناسبة لتقييم أثر التكنولوجيا على حقوق الإنسان والتخفيف من حدته. التهديدات المتعلقة بالذكاء الاصطناعي كثيرة ومتنوعة، والسبب هو أن له العديد من التطبيقات، لذلك من الصعب الاحاطة فيها كلها، الأمر الذي يوجه الاهتمام الدولي الى حماية الحقوق الأساسية للمواطنين في ظل هذا الاجتياح التقني للعالم، والعمل بشكل متواصل للاحاطة بهذه التهديدات. في لبنان ما زال المشترع بعيداً عن العمل الجدي لتطوير القوانين وللاحاطة بهذه التقنية اسوة بالدول المتطورة، وعلى صعيد السلطة التنفيذية لم تضع الحكومة بعد استراتيجية وطنية لادخال الذكاء الاصطناعي في القطاع العام. العمل الوحيد المهم والسباق على الصعيد الوطني كان اصدار حوكمة وارشادات الذكاء الاصطناعي في لبنان من قبل كلية الحقوق والعلوم السياسية والادارية في الجامعة اللبنانية.

*كيف تعرفين الذكاء الاصطناعي من منظور قانوني؟

يمكن تعريف الذكاء الاصطناعي بأنّه الأنظمة التي تظهر سلوكًا ذكيًّا من خلال تحليل بيئتها، والتعلّم الآلي، واتّخاذ إجراءات، بدرجة معيّنة من الاستقلالية لتحقيق أهداف محدّدة.

فهو علم يمكّن الآلة من فعل ما يفعله البشر بقدر معيّن من الذكاء. في حين أنّ الخوارزميّات، التي تشكّلها، هي مجموعة من القواعد التي تحدّد بدقّة سلسلة من التعليمات التي تحلّ مشكلة، أو تنجز مهمّة. بمعنى آخر، إنّه منطق، أو إجراء، أو صيغة لحلّ مشكلة معيّنة، يتعلّق الأمر بتحليل تسلسلي، للمعادلات والقواعد والمجموعات وهياكل البيانات والرسوم البيانية، وما إلى ذلك.

*ما هي أبرز التحديات القانونية والأخلاقية التي يطرحها الذكاء الاصطناعي؟

المخاطر عديدة ومتنوعة، سأحاول تعداد أبرزها ومنها المتعلقة بالحق في حماية الخصوصية، لأن تشغيل الأنظمة الذكية يتطلب تدريبها على البيانات التي قد تتضمن بيانات شخصية، ومن الصعب إن لم يكن من المستحيل على الأفراد حماية جميع حقوقهم على بياناتهم الشخصية . فقد ينجم عن انتهاك الخصوصية محاولات سرقة الهوية والابتزاز عبر التزييف العميق. بالاضافة إلى انتهاكات للحق في تقرير المصير والمشاركة السياسية والسلامة العقلية للأفراد الناتجة عن توليد واستخدام المحتوى الاصطناعي للتلاعب من قبل الجهات الفاعلة الخبيثة، بما في ذلك المعلومات المضللة والهجمات الإلكترونية للهندسة الاجتماعية مثل التصيد الاحتيالي.

من جهة أخرى يُنتهك قانون الملكية الفكرية بشكل كبير، فمجموعة بيانات التدريب للنماذج الذكية تحتوي بشكل منهجي على إبداعات محمية بحقوق المؤلف، مثل الكتب واللوحات والموسيقى. والذكاء الاصطناعي قادر على إعادة إنتاج عمل محمي ، أو أسلوب فنان ما. ما يؤدي الى انتهاك حقوق المؤلف والمبدع ويمكن أن يؤدي أيضا إلى حالة من المنافسة غير العادلة عندما يحل النظام الذكي محل المؤلف أو الفنان.

تبقى قضايا التعويض على المتضررين التي تتطلب البحث عن المسؤول عن الضرر اللاحق بهم والتي تشكل تحدياً مهماً في ظل انتشار الأنظمة الذكية.

*هل تعتقدين أنه يجب منح الأنظمة الذكية صفة قانونية؟ ولماذا؟

في الوضع الراهن للتقنية، لا أؤيد موضوع اعطاء شخصية قانونية للذكاء الاصطناعي على الاطلاق، لا سيما وأن المشترع الأوروبي تخلى عن هذه الفكرة منذ العام 2020 وعمل على تنظيم قواعد المسؤولية، بدلاً من اعطاء الأنظمة الذكية هذه الشخصية. فمن الناحية القانونية تتطلب الأعمال القانونية إرادة حرّة، وهي خاصّيّة لا يمكن أن يتمتّع بها إلّا الأفراد. إنّ خلق الإنسان الآلي الذي يتمتّع بالذكاء الاصطناعي له طبيعة وظيفية تميّزه، ولا يمكن اعتباره على الإطلاق صاحب حقّ. كما أنّ إمكانية التحرّك بشكل مستقلّ لا تكفي لإعطائه الشخصيّة القانونية، شأنه شأن الحيوانات القادرة على التحرّك بشكل مستقلّ. ومن الناحية الأخلاقية، يثير منح الشخصية القانونية لأنظمة الذكاء الاصطناعي قضايا أخلاقية مهمّة تتعلّق بالحقوق التي يمكن منحها إيّاها، وما إذا كان يقتضي أن تكون مماثلة لحقوق الإنسان، كالحقّ في الحياة، أو السلامة الجسدية، أو احترام الكرامة. هذا فضلاً عن طريقة معاملة هذه الأنظمة، هل يجب معاملة الروبوتات بالرحمة والعطف، حتى لو لم يشعروا بالعواطف؟

*كيف يمكن تحديد المسؤولية القانونية عند وقوع ضرر ناتج عن قرارات أو أفعال أنظمة الذكاء الاصطناعي؟

من يتسبّب بضررللغير يلزم بالتعويض، هذه هي الغاية الأساسية من المسؤولية المدنية. يصطدم إيجاد نظام آمن للمسؤولية التي تطبّق على الذكاء الإصطناعي بمشكلتين أساسيتين:

الأولى تتعلّق بتعدّد الفاعلين الذين يؤثّرون بنشاط الذكاء الاصطناعي، وصعوبة تحديد نسبة مساهمة كلّ منهم بالضرر الناجم عن هذا النشاط، والثانية تعود إلى أثر “الصندوق الأسود” الذي لا يسمح دائماً بتحديد الخطأ. يمكن أن تتسبّب جميع الأجهزة المادية أو الافتراضية التي تديرها أنظمة الذكاء الاصطناعي في حدوث أضرار مختلفة.

من المحتمل أن يتسبّب الذكاء الاصطناعي، أوّلًا وقبل كلّ شيء، في ضرر جسدي ويمكن أن يتسبّب أيضًا بأضرار معنوية. أما الإشكالية الأساسية التي أثارت الجدل القانوني، فتتعلّق بإمكانية تحميل المسؤولية للذكاء الاصطناعي الذي لديه القدرة على اتّخاذ القرار باستقلالية. الا أن هذه الفرضية استبعدت نتيجة عدم اعطاء شخصية قانونية للذكاء الاصطناعي، وقد أدخل القانون الأوروبي مساهمات مهمة في هذا الاطار على صعيد المسؤولية المدنية لتسهيل الكشف على الأدلة وتسهيل الاثبات وافتراض رابطة سببية بين الخطأ والضرر، فصلناها في الكتاب.

*ما هو رأيكِ في مسؤولية المصممين والمستخدمين والمشغلين لهذه الأنظمة؟

بعيداً عن المنطق القانوني، تستجيب مسألة المسؤولية لمنطق أخلاقي يتعلق في البحث عن المسؤول وعن السلوك المضرّ الذي يجب أن يتوقّف، وعن الضرر الواجب التعويض عنه. فمن هو المسؤول عن الضرر: المصمّم، أم المنفّذ، أم المنتج، أم المورّد، أم المشغّل، أم المالك، أم المستخدم.

يمكن اعتبار انّه من المحتمل، بشكل معقول ونظراً لظروف الواقعة، أنّ يكون الخطأ قد أثّر على نتيجة الذكاء الاصطناعي، أو على عدم قدرة النّظام على تحقيق نتيجة مرجوّة . فاذا كان الخطأ ناجماً عن التصميم يتحمل المسؤولية المصمم واذا نجم عن الاستخدام يتحمل المسؤولية المستخدم. الاشكالية تقع في صعوبة اثبات مصدر الخطأ.

في حال رفع دعوى تعويضات ضد مورد نظام ذكاء اصطناعي عالي الخطورة أو ضد شخص خاضع لإلتزامات المزود وأثبت مقدم الشكوى أن المورد أو عند الاقتضاء الشخص المذكور، لم يراع الالتزامات المفروضة على المورد، يتحمل هذا الأخير المسؤولية. وفي حال رفع دعوى تعويض ضد مستخدم نظام ذكاء اصطناعي عالي الخطورة تعتبر مسؤولية المستخدم متحققة عندما يثبت مقدّم الطلب أنّ المستخدم لم يمتثل لالتزامات التشغيل أو المراقبة وفقًا لتعليمات الاستخدام المرفقة أو عند الاقتضاء، لتعليق أو وقف استخدام النظام. بكل الأحوال سهل القانون الأوروبي عملية الاثبات كما ذكرنا.

*ما هي المخاطر التي يشكلها الذكاء الاصطناعي على خصوصية الأفراد وبياناتهم الشخصية؟

علاقة الذكاء الاصطناعي مع مستخدميه نزاعيّة، فمن جهة يعتمدون عليه، ومن جهة أخرى لا يثقون به. فهو يوصي بمحتوى جديد يتكيّف مع أذواقهم (الأفلام والموسيقى)، ويراقب صحّتهم، ويحسّن رحلاتهم، وحتى يتدخّل في علاقاتهم الاجتماعية عبر تطبيقات متطوّرة. يرجع هذا الأمر، إلى حدّ كبير، إلى التجميع الهائل للبيانات الشخصية للأفراد من خلال تطبيقات الذكاء الاصطناعي. إنّ قدرته على أن يصبح عنصرًا عاديًّا في بيئتنا، هي التي يمكن أن تجعله خطيرًا على خصوصية المستخدمين، لأنّهم لم يعودوا ينظرون إليه كأداة لجمع البيانات الشخصية، وهي عملية غير مرئيّة تقريبًا بالنسبة لهم. خلال الإندماج في حياة الأفراد اليومية، يؤدّي الذكاء الاصطناعي إلى إفراغ الخصوصية من مضمونها، وإفقار حياة الأفراد الخاصّة، ما يوجب العمل على حماية البيانات الشخصية.

*كيف يمكن تحقيق التوازن بين استخدام البيانات لتطوير الذكاء الاصطناعي وحماية حقوق الأفراد؟

تتراوح متطلّبات التوازن، بين القواعد المتعلّقة بتدريب الذكاء الاصطناعي، وحقوق المستخدِمين، في ما يتعلّق بمعالجة بياناتهم الشخصية. تختلف الالتزامات المحدّدة لمقدّمي خدمات الذكاء الاصطناعي بشكل كبير بين الدول. وكثيرًا ما يتمّ تكليف البشر لمراقبته نظرًا لأنّ العديد من المخاوف التنظيمية المتعلّقة بالذكاء الاصطناعي تنشأ من تسليم البشر له. بموجب هذه المتطلّبات يتمكّن البشر من الإشراف على عمليّات صنع القرار في الذكاء الاصطناعي، أو التدخّل فيها، بهدف تحسين قدرة الوكالة البشرية والرقابة. تقوم حقوق التفاعل على توفير الحقّ في الاعتراض على القرارات المدعومة من أنظمة الذكاء الاصطناعي، أو على القرارات التي يتّخذها الذكاء الاصطناعي . يمكّن هذا الحق المستخدمين من رفض الخضوع لقرارات مصنوعة بواسطة الأنظمة الذكية.

*كيف يمكن التعامل مع قضايا الملكية الفكرية عندما يقوم الذكاء الاصطناعي بإنشاء محتوى جديد؟

يثير الإبداع، الذي يقوم به الذكاء الاصطناعي، العديد من الإشكاليات، ويضع قانون الملكية الفكرية بمواجهتها، وذلك بهدف التوصّل إلى إمكانية فهمها، والإحاطة بها بشكل فعّال. علماً أنّ التطوّر التكنولوجي يسبق بشكل كبير تطوّر القانون، ما يثير صعوبات مهمة تواجه تطبيق قانون الملكية الفكرية على الذكاء الاصطناعي. فالمؤلّف لا يمكن أن يكون إلّا شخصاً طبيعياً، وحقّ المؤلّف ينشأ من حيث المبدأ لصالح المؤلّف، أي الشخص الطبيعي. وبالتالي فإن الذكاء الاصطناعي لا يمكن اعتباره صاحب حق المؤلف على المحتوى الذي ينشئه في ظل القوانين المرعية الاجراء.

*هل يجب منح الأنظمة الذكية حقوقًا على ابتكاراتها؟

إنّ دمج الذكاء الاصطناعي في القطاع الإبداعي يثير حتمًا العديد من الأسئلة التي لا تزال دون إجابة في الوقت الراهن. فحماية أيّ إبداع تعني تحديد صاحب الحقّ. في عصر الذكاء الاصطناعي، قد يكون مالك النظام، أو المستخدِم، أو مصمّم البرنامج، أو الشركة المصنّعة. توجب الحماية بواسطة براءة الإختراع، من ناحية أولى، أن يكون الإختراع جديداً. من الصعب نقل هذا المفهوم إلى المنتجات التي تنتجها أنظمة الذكاء الاصطناعي التي تجمع بين مختلف المصادر الموجودة، لإنشاء لوحات، أو نصوص أفلام، أو مقالات صحفية، أو حتى موسيقى، علماً انه لا يمكن إعتبار كل الإنتاجات إختراعاً بأي شكل من الأشكال.

من ناحية ثانية، لكي يكون الإختراع قابلاً للحماية، يجب ان يكون هناك إبتكار. ما يدعو الى البحث بإمكانية توصيف العمل الناجم عن نظام الذكاء الاصطناعي على أنه “ابتكار”. إن الذكاء الاصطناعي، الذي لديه إمكانية التعلّم الذاتي، قادر على توليد إنتاجات تنطوي على نشاط ابتكاري معين. إلا أن ربط إعطاء الحق في البراءة بشخص طبيعي أو معنوي، هو الذي يثير مشاكل حقيقية عندما يطلب تطبيق هذه الحماية على المنتجات المستنبطة من الذكاء الاصطناعي. من هنا فإن الذكاء الاصطناعي لا يمكن أن يكون صاحب براءة اختراع في ظل القانون الحالي الذي يمنح الشخص الطبيعي، أي المخترع، وخلفاءه حقاً حصرياً باستثمار ابتكاره.

*ما هو تقييمكِ للإطار القانوني الحالي في لبنان لتنظيم الذكاء الاصطناعي؟

ليس هناك أي عمل جدي لتطوير الاطار القانوني في لبنان لمواكبة التطور التقني. اعتدنا في لبنان على أن نكون من الدول الأكثر تأخراً في اصدار تشريعات تواكب التقنيات الحديثة.

*ما هي الخطوات التي يجب اتخاذها لتطوير تشريعات مرنة ومتوازنة ؟

لا يزال الذكاء الاصطناعي يتطوّر ويتقدّم بشكل كبير يسبق كلّ التوقّعات. لم يتمّ تحديد إطار تنظيمي لحماية البيانات بوضوح حول هذا الموضوع. ومع ذلك، من أجل تعلّم أنظمة الذكاء الاصطناعي، تَستخدم نماذج اللغة المحادثات التي أجريت مع المستخدمين. ما يوجب اصدار قوانين توفر حماية أكبر للمستهلكين ضد الاستخدامات غير الملائمة لأنظمة الذكاء الاصطناعي. وضمان مستوى عال من الحماية فيما يتعلق بالصحة والسلامة والحقوق الأساسية، بما في ذلك الديمقراطية وسيادة القانون وحماية البيئة، من المخاطر المحتملة التي يمكن أن تشكلها أنظمة الذكاء الاصطناعي.

*كيف يؤثر الذكاء الاصطناعي على مهنة المحاماة والقضاء؟

يلعب الذكاء الاصطناعي، لا سيما التوليدي منه، دورًا بارزًا في تطوير مهنة المحاماة، ذلك أنّ منصّات المساعدة القانونية تعتبر مفيدة للممارسات القانونية، لأنّها تخفّف المشاكل التي يواجهها المحامون من جهة، وتقدّم حلولاً واقعية للقضايا القانونية التي تتطلّب مسارًا طويلاً. باستطاعة هذه الأنظمة تحليل التفاصيل القانونية، وحتى التنبّؤ بالنتائج القانونية، فتطوّر بذلك عمل المحامين المهني، وتؤمّن لهم الاستفادة من سرعة ودقّة الذكاء الاصطناعي. لكن لا تخفى على أحد المخاطر التي تتعرّض لها مهنة المحاماة بسبب هذا الذكاء.

لم يساهم الذكاء الاصطناعي في تطوير مهنة المحاماة وحسب، إنّما تدخّل بشكل كبير في العمل القضائي، ولم يعد القاضي الروبوت من ضروب الخيال في عصرنا الحاضر، فقد أصبح حقيقة في العديد من الدول، والمحكمة الرقمية تنتشر بسرعة في بقاع العالم.

*ما هي التحديات والفرص التي يطرحها في هذا المجال؟

على الرغم من أنّ أنظمة الذكاء الاصطناعي تساهم في تسهيل، وتحسين، وتسريع عمل المحامين من خلال تبسيط الإجراءات، والوصول بسرعة إلى النتائج القانونية، إلّا أنّه لا يمكنها إتمام جوانب مهنة المحاماة كافة بسهولة. على سبيل المثال، لا يمكنها تمثيل الموكّلين أمام القضاء، كما أنّها تفتقر إلى القدرة على فهم وتطبيق الفروقات الدقيقة والتعقيدات في القانون، الأمر الذي يتطلّب فهمًا عميقًا للمبادئ القانونية، والقدرة على التفكير النقدي. لا يخلو هذا التحوّل من المخاوف، وسيكون من الضروري لمهنة المحاماة معالجة القضايا الأخلاقية مع انتشار الذكاء الاصطناعي على نطاق واسع، لعلّ أبرز هذه التحدّيات: التحيّز والهلوسة والتمييز.

*ما هي المبادئ الأخلاقية التي يجب دمجها في تصميم وتطوير أنظمة الذكاء الاصطناعي؟

يتطلب استعمال الذكاء الاصطناعي بشكل آمن ومسؤول احترام المبادئ الأخلاقية الأساسية، أبرزها: الانسانية وتحقيق الأمن المجتمعي، واحترام الخصوصية، والمسؤولية والمساءلة، والشفافية وقابلية التفسير، والانصاف والشمولية، والموثوقية. فضلاً عن اعتماد ادوات تحليلية لتحليل أوتعديل نظام الذكاء الاصطناعي لفهم تأثيره على المجموعات السكانية المختلفة.

*كيف يمكن ضمان استخدام مسؤول وآمن لهذه التقنيات؟

يمكن ضمان استخدام آمن ومسؤول للذكاء الاصطناعي من خلال معالجة القضايا الأخلاقية وقضايا الخصوصية ، ومنع مخاطر التلاعب وتركيز السلطة ، ووضع القوانين والإطار المناسبين ، يمكن الاستفادة من امكانات الذكاء الاصطناعي واستخدامه بشكل آمن وضمان العدالة والشمولية والديمقراطية.

*ما هي التوصيات التي تقدمينها للمشرعين والأكاديميين وصناع القرار لمواجهة التحديات القانونية والأخلاقية المرتبطة بالذكاء الاصطناعي؟

في مواجهة تحديات وحدود دمج الذكاء الاصطناعي في القطاعات المختلفة، من الضروري وضع التنظيم والإشراف المناسبين. يجب على السلطات وضع معايير ومبادئ توجيهية لتأطير استخدام الذكاء الاصطناعي في القطاعين العام والخاص، وضمان استخدام التقنيات بشكل أخلاقي وشفاف ومسؤول. بالإضافة إلى ذلك، من المهم تعزيز التعاون بين الحكومات والمنظمات الدولية والجهات الفاعلة في القطاع الخاص والمجتمع المدني من أجل تبادل أفضل الممارسات ووضع معايير مشتركة لاستخدام الذكاء الاصطناعي في سن القوانين.